De Wikipedia, la enciclopedia libre

Para otros usos de este término, véase Causalidad. En física, el término causalidad describe la relación entre causas y efectos, y es fundamental en todas las ciencias naturales, especialmente en física. En términos generales, la causalidad puede ser estudiada desde varias perspectivas: la filosófica, la de la computación y la estadística.

[editar] Introducción

En física clásica se asumía que todos los eventos están causados por otros anteriores y que dicha causalidad es expresable en términos de leyes de la naturaleza. Dicha pretensión llegó a su punto más alto en la afirmación de Pierre-Simon Laplace. Laplace afirmó que si se conoce el estado actual del mundo con total precisión, uno puede predecir cualquier evento en el futuro. Esta perspectiva se conoce como determinismo o más precisamente determinismo causal.

Aunque el determinismo de Laplace parece correcto respecto a las ecuaciones aproximadas de la física clásica, la teoría del caos ha añadido pequeñas complicaciones. Muchos sistemas presentan una fuerte sensibilidad a las condiciones iniciales, lo que significa que condiciones iniciales muy similares en ciertos sistemas pueden conducir a comportamientos a largo plazo muy diferentes. Eso sucede por ejemplo en el tiempo atmosférico. Hacia 1987 era habitual usar superordenadores en la predicción del tiempo, por ejemplo el Cray X-MP del Centro Europeo para el Pronóstico del Tiempo a Medio Plazo, que operaba con una capacidad máxima de 800 megaflops, podía calcular en apenas media hora un pronóstico aceptable del tiempo para el día siguiente en todo el hemisferio. Y aunque cada día se realizaban pronósticos de los siguientes diez días, los resultados del pronóstico a partir del cuarto o quinto día diferían sensiblemente de lo previsto por el ordenador.[1]

Sin embargo, por encima de la impredictibilidad práctica causada por el comportamiento estocástico o caótico de los sistemas clásicos, está el hecho de que la mecánica cuántica presenta junto con una evolución determinista recogida en la ecuación de Schrödinger, una evolución no-determinista recogida en el postulado del colapso de la función de onda.

[editar] Mecánica relativista

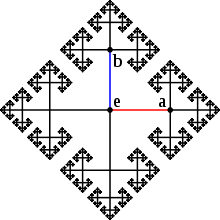

De acuerdo con los postulados comunes de la física newtoniana, la causa precede al efecto en el tiempo. Sin embargo, en la física moderna, el concepto más simple de causalidad ha necesitado ser clarificado. Por ejemplo, en la teoría de la relatividad especial, el concepto de causalidad se mantiene, pero el significado de "preceder en el tiempo" sigue siendo absoluto y no depende del observador (aunque no pasa igual con el concepto de simultaneidad de conceptos no relacionados causalmente, que ahora sí pasan a depender del observador). Consecuentemente, el principio relativista de causalidad dice que la causa precede a su efecto para observadores inerciales. Esto implica que, en términos de la teoría de la relatividad especial, una condición necesaria para que A sea causa de B, es que B sea un evento que pertenece al cono de luz de A (en términos de distancias espacio-temporales se dice que A y B están separados por intervalo temporaloide). A pesar de algunas obras de ciencia ficción, en los supuestos bajo los cuales la teoría de la relatividad especial es adecuada para describir el mundo, resulta imposible, no sólo influir en el pasado, sino también en objetos distantes mediante señales que se muevan más rápidas que la velocidad de la luz.

En la teoría general de la relatividad, el concepto de causalidad se generaliza de la manera más directa posible: el efecto debe pertenecer al cono de luz futuro de su causa, aún en espacio-tiempos curvos; aunque pueden aparecer ciertas complicaciones, como cuando uno trata soluciones exactas de las ecuaciones de Einstein, como el Universo de Gödel, donde existen curvas temporales cerradas, y un observador puede verse a sí mismo en el pasado, y otra serie de peculiaridades que, no obstante, no incurren en ninguna paradoja.[2]

[editar] Mecánica cuántica

Nuevas sutilezas se toman en cuenta cuando se investiga la causalidad en mecánica cuántica no relativista y teoría cuántica de campos (mecánica cuántica relativista). En la teoría cuántica de campos, la causalidad está estrechamente relacionada con el principio de localidad. El análisis de ese principio es delicado, y muchas veces ese análisis pasa por el uso del teorema de Bell. De todas maneras, el resultado de dicho análisis parece depender, en parte, de desde qué interpretación de la mecánica cuántica se interpreten los resultados.

Sin embargo, se sospecha que, aún con todas estas sutilezas, el principio de causalidad sigue siendo un concepto válido de toda teoría física realista. Así, parece que la noción de que los eventos pueden ser ordenados en causas y efectos es necesaria para prevenir ciertas paradojas del mundo que conocemos.

La base de la causalidad física son los procesos energéticos que están gobernados por el principio físico de la conservación de la energía.

[editar] Principio de causalidad

El principio de causalidad postula que todo efecto -todo evento- debe tener siempre una causa (que, en idénticas circunstancias, una causa tenga siempre un mismo efecto se conoce como "principio de uniformidad"). Se usa para la búsqueda de leyes definidas, que asignan a cada causa su correspondiente efecto.

Este principio refleja un comportamiento mecánico de la naturaleza, que hasta el siglo XX se había aceptado e interpretado en un sentido determinista. No obstante, a principios de este siglo Heisenberg introdujo su principio de incertidumbre, que modificaba profundamente el principio de causalidad clásico.

Heisenberg y otros padres de la mecánica cuántica introdujeron un modelo de átomo que renunciaba a la visión clásica de un compuesto de partículas y ondas. Se concluyó que estaba condenado al fracaso cualquier intento de establecer analogías entre la estructura atómica y nuestra intuición sobre objetos macroscópicos. La formulación matemática de la teoría de Heisenberg se llamó inicialmente mecánica matricial, porque requería del uso de las matrices del álgebra lineal clásica. Esta formulación resultó complementaria de la mecánica ondulatoria, del físico austriaco Erwin Schrödinger.

Usando esta mecánica, los niveles de energía u órbitas de electrones se describen en términos probabilísticos: en general, de una misma causa no se deriva siempre un mismo efecto, sino que existe una variedad de posibles efectos. Sólo se puede predecir (aunque, en principio, con una fiabilidad determinista total) la probabilidad de que, cuando la causa se produzca, ocurra cada uno de los efectos.

Este comportamiento resulta extraño para nuestra experiencia ordinaria. Su explicación la podemos resumir en los siguientes puntos, que deben aceptarse como postulados avalados por miles de observaciones experimentales:

- Existen propiedades de la materia (observables) que no se pueden medir simultáneamente (observables que no conmutan). Por ejemplo, la posición y la velocidad de una misma partícula sería un par de propiedades de este tipo. Para ilustrar esa situación con un análogo clásico burdo, piénsese que, si un microscopio es lo suficientemente sensible como para hacer visible un electrón, deberá enviar una cantidad mínima de luz u otra radiación apropiada sobre él, que lo haga visible. Pero el electrón es tan pequeño que este mínimo de radiación (digamos, un fotón) es suficiente para hacerle cambiar de posición apenas lo tocara, de modo que en el preciso instante de medir su posición, alteraríamos ésta.

- Supongamos que hemos medido una de estas propiedades observables, de modo que conocemos con precisión su valor. Cuando un instante después midamos la segunda propiedad, obtendremos uno de los posibles valores de esta segunda propiedad, pero no podemos predecir antes cuál: sólo se puede predecir la probabilidad con la que cada uno de los valores posibles serán obtenidos.

Para algunos autores, desde el punto de vista filosófico, esto supone renunciar al principio de causalidad: podemos hallar dos sistemas físicos que han sido preparados exactamente del mismo modo, pero tales que, al medir una misma propiedad de ambos, obtenemos un resultado distinto en cada caso. No existe ninguna causa por la que hayamos obtenido los resultados diferentes: la Naturaleza no es determinista. Sin embargo, sí se pueden determinar con precisión las probabilidades de obtener las posibles medidas. Y como los objetos macroscópicos están formados por números gigantescos de partículas, las predicciones probabilísticas cuánticas acaban siendo, estadísticamente hablando, totalmente precisas, lo que hace de la Mecánica Cuántica una teoría extraordinariamente exacta.

La interpretación descrita de la mecánica cuántica es la que se ha impuesto con el tiempo, y se le llama interpretación de Copenhague en honor de la escuela del físico danés Niels Bohr. Inicialmente, la renuncia al principio de causalidad en esta interpretación no fue aceptada por muchos físicos, incluyendo a Einstein, quien afirmó: “Dios no juega a los dados”. De hecho, el propio Einstein, en colaboración con Podolski y Rosen, ideó un experimento (Paradoja EPR, por las siglas de sus autores) tal que las conclusiones de la interpretación de Copenhague parecían absurdas. Bohr mostró que, aunque muy extrañas, estas conclusiones no son absurdas. Experimentos de este tipo fueron llevados a cabo a finales del siglo XX por Alain Aspect, y han confirmado la interpretación de Copenhague.

Sin embargo, esta interpretación se enfrenta todavía a la llamada paradoja del gato de Schrödinger (remarquemos que Schrödinger, como Einstein, fue uno de los padres de la Mecánica Cuántica). Esta paradoja, que afecta a la definición de lo que es un proceso de medida (la distinción entre la materia observada y la mente del observador), no ha podido ser aún explicada de forma satisfactoria.

Existen multitud de efectos que se derivan del principio de incertidumbre. Uno de ellos, que afecta al ejemplo de incertidumbre posición-velocidad anterior, es la imposibilidad de la ausencia completa de energía cinética o, digamos, velocidad, para una partícula (ni siquiera en el cero absoluto). Si la energía cinética alcanzara el punto cero y las partículas quedaran totalmente inmóviles, sería posible confinarlas y determinar su posición con precisión arbitraria, a la vez que conoceríamos su velocidad (que sería cero). Por tanto, debe existir alguna “energía residual del punto cero”, incluso en el cero absoluto, para mantener las partículas en movimiento, y también, por así decirlo, nuestra incertidumbre. Esa energía “punto cero” se puede calcular, y resulta suficiente para evitar que el helio líquido se solidifique, incluso a temperaturas tan próximas como se quiera del cero absoluto (el cero en sí resulta inaccesible).

Las consecuencias del principio de incertidumbre se constatan en todas las partes de la microfísica, y acaban resultando asombrosas cuando se extrapolan al Universo en su conjunto. Así:

- Desde los tiempos de Einstein, en 1930, se sabía que el principio de incertidumbre también llevaba a la imposibilidad de reducir el error en la medición de energía sin acrecentar la incertidumbre del tiempo durante el cual se toma la medida. (De hecho, al principio, Einstein creyó poder utilizar esta tesis como trampolín para refutar el principio de incertidumbre, pero también Bohr mostró que la tentativa de Einstein era errónea).

- De esta versión de la incertidumbre se seguía que en un proceso subatómico se podía violar durante breves lapsos la ley de la conservación de la energía (siempre y cuando todo volviese al estado de conservación cuando concluyese ese lapso). En general, cuanto mayor sea la desviación de la conservación, tanto más breve será el intervalo de tiempo en que ésta es tolerable. El físico japonés Hideki Yukawa aprovechó esta noción para elaborar su teoría de los piones, confirmada experimentalmente.

- Más aún, posibilitó la elucidación de ciertos fenómenos subatómicos presuponiendo que las partículas nacían de la nada como un reto a la energía de conservación, pero se extinguían antes del tiempo asignado a su detección, por lo cual eran sólo “partículas virtuales”. Hacia fines de la década 1940-1950, tres investigadores (premios Nobel de Física en 1965) elaboraron la teoría sobre esas partículas virtuales: los físicos norteamericanos Julian Schwinger y Richard Phillips Feynman, y el físico japonés Shin'ichirō Tomonaga. Los diagramas de Feynman son usados corrientemente en la física de partículas, donde llevan a predicciones extremadamente exactas.

- A partir de 1976 se han producido especulaciones acerca de que el Universo comenzó como una pequeña pero muy masiva partícula virtual que se expandió con extrema rapidez y que aún sigue expandiéndose. Según este punto de vista, el Universo se formó de la Nada y podemos preguntarnos acerca de la posibilidad de que haya un número infinito de Universos que se formen (y, llegado el momento, acaben) en esta Nada.

En resumen, el principio de incertidumbre afectó profundamente al pensamiento de físicos y filósofos. Ejerció una influencia directa sobre la cuestión filosófica de causalidad, la relación entre causa y efecto. Pero sus implicaciones para la ciencia no son las que se suponen popularmente a menudo. Se puede leer que el principio de incertidumbre anula toda certeza acerca de la naturaleza, y muestra que, al fin y al cabo, la ciencia no sabe ni sabrá nunca hacia dónde se dirige, que el conocimiento científico está a merced de los caprichos imprevisibles de un Universo donde el efecto no sigue necesariamente a la causa. Pero tanto si esta interpretación es válida desde el ángulo filosófico como si no, el principio de incertidumbre no ha modificado un ápice la actitud del científico ante la investigación. Y esto por varios motivos:

- La incertidumbre también existe a un nivel clásico. Por ejemplo, incluso si nos olvidamos de posibles efectos cuánticos, no se puede predecir con certeza el comportamiento de las moléculas individuales en un gas. Sin embargo, estas moléculas acatan ciertas leyes termodinámicas, y su conducta es previsible sobre una base estadística. Estas predicciones son infinitamente más precisas que las de las compañías aseguradoras, que planifican su actividad (y obtienen beneficios) calculando con índices de mortalidad fiables, aunque les sea imposible predecir cuándo morirá un individuo determinado.

- Ciertamente, en muchas observaciones científicas, la incertidumbre es tan insignificante comparada con la escala correspondiente de medidas, que se la puede descartar para todos los propósitos prácticos. Uno puede determinar simultáneamente la posición y el movimiento de una estrella, o un planeta, o una bola de billar, o incluso un grano de arena con exactitud absolutamente satisfactoria.

- La incertidumbre entre las propias partículas subatómicas no representa un obstáculo, sino una verdadera ayuda para los físicos. Se la ha empleado para entender el modelo atómico (que resultaba inestable desde el punto de vista no cuántico), esclarecer hechos sobre la radiactividad, sobre la absorción de partículas subatómicas por los núcleos, y otros muchos acontecimientos subatómicos. En ello se emplea una economía lógica y razonabilidad muy superior de lo que hubiera sido esperable sin él.

Es cierto que el principio de incertidumbre o, en general, la física cuántica, se enfrenta a la paradoja no resuelta del problema de la medición (el gato de Schrödinger). Pero ésta tiene sus orígenes en la distinción entre mente y materia, determinismo y libre albedrío, y profundiza en ella como nunca antes habían imaginado los filósofos. El principio de incertidumbre significa que el Universo es más complejo de lo que se suponía, pero no irracional.

[editar] Referencias

[editar] Bibliografía

[editar] Véase también

[editar] Enlaces externos

![begin{matrix} P(B) = P(B|A)P(A) + P(B|bar{A})P(bar{A}) = P(B|A)P(A) + P(B|bar{A})(1-P(A)) Rightarrow P(B) = P(B|bar{A}) + P(A)[P(B|A) - P(B|bar{A})] ge P(B|bar{A}) +varepsilon end{matrix}](https://petalofucsia.blogia.com/upload/externo-df061c8809c86aa0e507f5b983413b66.png)

![begin{matrix} P(B) = P(B|A)P(A) + P(B|bar{A})P(bar{A}) = P(B|A)(1-P(bar{A})) + P(B|bar{A})P(bar{A}) Rightarrow P(B) = P(B|A) + P(bar{A})[P(B|bar{A}) - P(B|A)] le P(B|A) - bar{varepsilon} end{matrix}](https://petalofucsia.blogia.com/upload/externo-33e257607960f378c076127393b66b67.png)

, de los conjuntos

, de los conjuntos  es un subconjunto del

es un subconjunto del

en este caso se representa

en este caso se representa  como

como  , pudiéndose decir que la relación pertenece a A a la n.

, pudiéndose decir que la relación pertenece a A a la n.

...

...

indexada por un conjunto

indexada por un conjunto

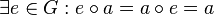

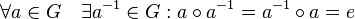

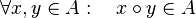

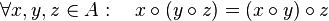

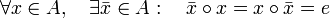

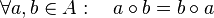

es un conjunto G en el que se ha definido una

es un conjunto G en el que se ha definido una  que satisface los siguientes

que satisface los siguientes

", o "

", o " , el conjunto de

, el conjunto de  , el conjunto de los

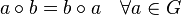

, el conjunto de los  , el conjunto de los números reales (excluyendo al 0) con la multiplicación, es un grupo abeliano; donde el elemento neutro es el 1, y el simétrico de x es 1/x. Notar que al no tener el

, el conjunto de los números reales (excluyendo al 0) con la multiplicación, es un grupo abeliano; donde el elemento neutro es el 1, y el simétrico de x es 1/x. Notar que al no tener el  con la suma, es un grupo abeliano.

con la suma, es un grupo abeliano. en un espacio topológico X forman un grupo no necesariamente abeliano. Ésta construcción es el

en un espacio topológico X forman un grupo no necesariamente abeliano. Ésta construcción es el  .

.

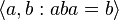

y que corresponde al

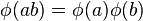

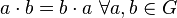

y que corresponde al  es un homomorfismo entonces obedece

es un homomorfismo entonces obedece

es un grupo con respecto a la operación

es un grupo con respecto a la operación

"

" .

.

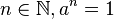

posee torsión o, que es de torsión, si para algún

posee torsión o, que es de torsión, si para algún  . Si a es de torsión, entonces el menor número natural n con la propiedad

. Si a es de torsión, entonces el menor número natural n con la propiedad  ), en los

), en los  ) y en los

) y en los  ). Los vectores libres del espacio, con la suma de vectores, forman un grupo conmutativo. La suma de matrices define una estructura de grupo conmutativo en las matrices con coeficientes reales (digamos) con un número de columnas y filas prefijado. Las funciones reales de variable real, con la suma de funciones, también forman un grupo conmutativo, al igual que las sucesiones de números reales con la suma de sucesiones.

). Los vectores libres del espacio, con la suma de vectores, forman un grupo conmutativo. La suma de matrices define una estructura de grupo conmutativo en las matrices con coeficientes reales (digamos) con un número de columnas y filas prefijado. Las funciones reales de variable real, con la suma de funciones, también forman un grupo conmutativo, al igual que las sucesiones de números reales con la suma de sucesiones.