ECONOMÍA: FUNCIONES DE CORRELACIÓN (VER FUNCIONES DE CORRELACIÓN CRUZADAS) CON UN CENTRO DE DISTRIBUCIÓN. La función de autocorrelación se define como la correlación cruzada de la señal consigo misma. La función de autocorrelación resulta de gran utilidad para encontrar patrones repetitivos dentro de una señal, como por ejemplo, la periodicidad de una señal enmascarada bajo el ruido o para identificar la frecuencia fundamental de una señal que no contiene dicha componente, pero aparecen numerosas frecuencias armónicas de esta. En teoría de la probabilidad y estadística, la distribución de probabilidad de una variable aleatoria es una función que asigna a cada suceso definido sobre la variable aleatoria la probabilidad de que dicho suceso ocurra. La distribución de probabilidad está definida sobre el conjunto de todos los eventos rango de valores de la variable aleatoria.

Autocorrelación

La autocorrelación es una herramienta matemática utilizada frecuentemente en el procesado de señales.

La función de autocorrelación se define como la correlación cruzada de la señal consigo misma. La función de autocorrelación resulta de gran utilidad para encontrar patrones repetitivos dentro de una señal, como por ejemplo, la periodicidad de una señal enmascarada bajo el ruido o para identificar la frecuencia fundamental de una señal que no contiene dicha componente, pero aparecen numerosas frecuencias armónicas de esta.

Contenido[ocultar] |

[editar] Definiciones de la función de autocorrelación

Dependiendo del campo de estudio se pueden definir diferentes tipos de autocorrelación sin que estas definiciones sean equivalentes. En algunos campos se utilizan indistintamente las funciones de autocorrelación y de autocovarianzas, dado que ambas sólo difieren entre sí en una constante de proporcionalidad que es la varianza (en este caso, la autocovarianza de orden k=0).

[editar] Estadística

En estadística, la autocorrelación de una serie temporal discreta de un proceso Xt es simplemente la correlación de dicho proceso con una versión desplazada en el tiempo de la propia serie temporal.

Si Xt representa un proceso estacionario de segundo orden con un valor principal de μ se define entonces:

![R(k) = frac{E[(X_i - mu)(X_{i+k} - mu)]}{sigma^2}](https://petalofucsia.blogia.com/upload/externo-4b131016668287ab30c4f7f1a9d596f4.png)

donde E es el valor esperado y k el desplazamiento temporal considerado (normalmente denominado desfase). Esta función varía dentro del rango [−1, 1], donde 1 indica una correlación perfecta (la señal se superpone perfectamente tras un desplazamiento temporal de k) y −1 indica una anticorrelación perfecta. Es una práctica común en muchas disciplinas el abandonar la normalización por σ2 y utilizar los términos autocorrelación y autocovarianza de manera intercambiable.

[editar] Procesamiento de señales

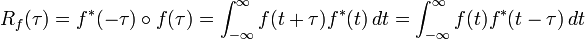

En el procesamiento de señales, dada una señal temporal f(t), la autocorrelación continua Rf(τ) es la correlación continua cruzada de f(t) consigo mismo tras un desfase τ, y se define como:

donde f * representa el conjugado complejo y el círculo representa una convolución. Para una función real, f * = f.

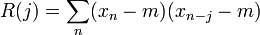

Formalmente, la autocorrelación discreta R con un desfase j para una señal xn es

donde m es el valor esperado de xn.

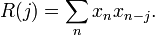

Frecuentemente las autocorrelaciones se calculan para señales centradas alrededor del cero, es decir con un valor principal de cero. En ese caso la definición de la autocorrelación viene dada por:

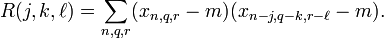

Las autocorrelaciones multidimensionales pueden definirse de manera similar. Por ejemplo, en tres dimensiones puede definirse la autocorrelación de una función como:

[editar] Propiedades

Definiremos las propiedades de la autocorrelación unidimensional. La mayoría de sus propiedades son extensibles fácilmente a los casos multidimensionales.

- Simetría: R(i) = R(−i),

- La función de autocorrelación alcanza un valor máximo en el origen, donde alcanza un valor real. El mismo resultado puede encontrarse en el caso discreto.

- Como la autocorrelación es un tipo específico de correlación mantiene todas las propiedades de la correlación.

- La autocorrelación de una señal de ruido blanco tendrá un fuerte pico en τ = 0 y valores cercanos a cero y sin ninguna estructura para cualquier otro τ . Esto muestra que el ruido blanco carece de periodicidad.

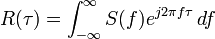

- Según el teorema de Wiener-Khinchin, la función de autocorrelación es la transformada inversa de Fourier de la densidad espectral:

Igualmente, el espectro se relaciona con la función de autocorrelación:

La consecuencia es que la señal puede expresarse indistintamente en el dominio del tiempo (t) o el dominio de las frecuencias (f), al existir esta correspondencia entre ambos, y entendiendo que la señal está completamente determinada a partir del total de sus momentos o del total de sus frecuencias.

[editar] Aplicaciones

- Una de las aplicaciones de la autocorrelación es la medida de espectros ópticos y en especial la medida de pulsos muy cortos de luz.

- En óptica, la autocorrelación normalizada y la correlación cruzada proporcionan el grado de coherencia de un campo electromagnético.

- En el procesamiento de señales, la autocorrelación proporciona información sobre las periodicidades de la señal y sus frecuencias características como los armónicos de una nota musical producida por un instrumento determinado (tono y timbre).

[editar] Enlaces externos

- MathWorld: Autocorrelation (en inglés)

- Autocorrelation articles in Comp.DSP (DSP usenet group). (en inglés)

Distribución de probabilidad

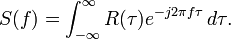

En teoría de la probabilidad y estadística, la distribución de probabilidad de una variable aleatoria es una función que asigna a cada suceso definido sobre la variable aleatoria la probabilidad de que dicho suceso ocurra. La distribución de probabilidad está definida sobre el conjunto de todos los eventos rango de valores de la variable aleatoria.

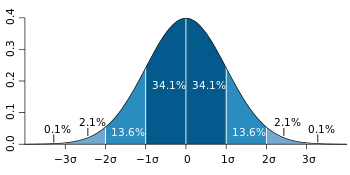

Cuando la variable aleatoria toma valores en el conjunto de los números reales, la distribución de probabilidad está completamente especificada por la función de distribución, cuyo valor en cada real x es la probabilidad de que la variable aleatoria sea menor o igual que x.

Contenido[ocultar] |

[editar] Definición de función de distribución

Dada una variable aleatoria todos son puntos X, su función de distribución, FX(x), es

Por simplicidad, cuando no hay lugar a confusión, suele omitirse el subíndice X y se escribe, simplemente, F(x).

[editar] Propiedades

Como consecuencia casi inmediata de la definición, la función de distribucion:

- Es una función continua por la derecha.

- Es una función monótona no decreciente.

Además, cumple

y

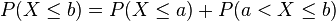

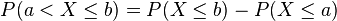

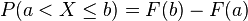

Para dos números reales cualesquiera a y b tal que (a < b), los sucesos  y

y  son mutuamente excluyentes y su unión es el suceso

son mutuamente excluyentes y su unión es el suceso  , por lo que tenemos entonces que:

, por lo que tenemos entonces que:

y finalmente

Por lo tanto una vez conocida la función de distribución F(x) para todos los valores de la variable aleatoria x conoceremos completamente la distribución de probabilidad de la variable.

Para realizar cálculos es más cómodo conocer la distribución de probabilidad, y sin embargo para ver una representación gráfica de la probabilidad es más práctico el uso de la función de densidad.

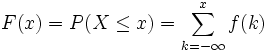

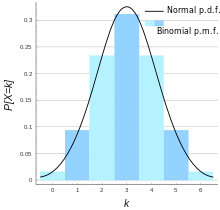

[editar] Distribuciones de variable discreta

Se denomina distribución de variable discreta a aquella cuya función de probabilidad sólo toma valores positivos en un conjunto de valores de X finito o infinito numerable. A dicha función se le llama función de masa de probabilidad. En este caso la distribución de probabilidad es el sumatorio de la función de masa, por lo que tenemos entonces que:

Y, tal como corresponde a la definición de distribución de probabilidad, esta expresión representa la suma de todas las probabilidades desde  hasta el valor x.

hasta el valor x.

[editar] Distribuciones de variable discreta más importantes

Las distribuciones de variable discreta más importantes son las siguientes:

- Distribución binomial

- Distribución binomial negativa

- Distribución Poisson

- Distribución geométrica

- Distribución hipergeométrica

- Distribución de Bernoulli

- Distribución Rademacher, que toma el valor 1 con probabilidad 1 / 2 y el valor -1 con probabilidad 1 / 2.

- Distribución uniforme discreta, donde todos los elementos de un conjunto finito son equiprobables.

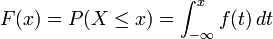

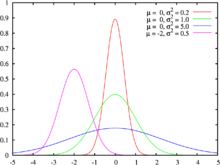

[editar] Distribuciones de variable continua

Se denomina variable continua a aquella que puede tomar cualquiera de los infinitos valores existentes dentro de un intervalo. En el caso de variable continua la distribución de probabilidad es la integral de la función de densidad, por lo que tenemos entonces que:

[editar] Distribuciones de variable continua más importantes

Las distribuciones de variable continua más importantes son las siguientes:

- Distribución ji cuadrado

- Distribución exponencial

- Distribución t de Student

- Distribución normal

- Distribución Gamma

- Distribución Beta

- Distribución F

- Distribución uniforme (continua)

[editar] Enlaces externos

Wikimedia Commons alberga contenido multimedia sobre Distribuciones de probabilidad. Commons

Wikimedia Commons alberga contenido multimedia sobre Distribuciones de probabilidad. Commons- Wikilibros: Estadística

0 comentarios